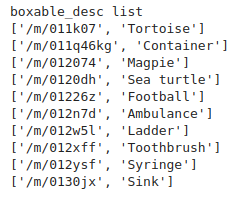

엑셀의 확장자로 흔하게 볼 수 있는 형식인 , 콤마를 구분자로 하여 파일을 구성하는 CSV 파일을 파이썬에서 다룰 수 있는 라이브러리를 공부해보자. (CSV : Comma-separated values) 파이썬에서는 csv라는 라이브러리를 지원한다. 우선, csv 라이브러리를 임포트해준다. import csv 그 이후는 아주 쉽다. # 불러올 파일 변수 path = "class-descriptions-boxable.csv" # 파일을 python으로 로드하기 boxable_f = open(path, 'r', encoding='utf-8') print(type(boxable_f)) # # csv형태로 파일을 읽어준다. boxable_desc = csv.reader(boxable_f) # 불러온 파일 확인해..